1. INTRODUCCIÓN

El procesamiento de la información constituye una aproximación teórica cuyo objetivo es analizar los diversos procesos cognitivos internos que median entre la presentación de un estímulo (input) y la emisión de una respuesta (output). Como estos procesos mentales no son observables directamente, los investigadores se han visto obligados a desarrollar diversas técnicas con el fin de detectarlos y explorar su naturaleza.

Tradicionalmente, las medidas conductuales más importantes para evaluar el rendimiento de las personas en tareas de procesamiento de la información han sido la velocidad de la respuesta y la precisión de la misma. Junto a ellas, y en la actualidad, el uso de medidas fisiológicas contribuyen también de forma significativa a hacer observable lo inobservable.

2. LA APROXIMACIÓN TEÓRICA DEL PROCESAMIENTO DE LA INFORMACIÓN

El procesamiento de la información (PI) es un enfoque teórico que analiza los procesos cognitivos internos que median entre la recepción de un estímulo y la emisión de una respuesta. Desde el enfoque del PI se asume que estos estadios de procesamiento suceden uno tras otro, y que el resultado -output- de un estadio de procesamiento constituye la entrada -input- del siguiente. Para explicar la ejecución de una tarea o de una actividad en su totalidad, este modelo básico debería completarse con un mecanismo atencional y un sistema de memoria. El mecanismo atencional priorizaría o seleccionaría ciertas fuentes de información en detrimento de otras. Por su parte, el sistema de memoria mantendría la información inmediata relevante para la tarea y almacenaría conocimientos que podrían recuperarse durante la ejecución posterior.

La multitud de modelos específicos de PI difieren entre sí respecto a las propiedades atribuidas a cada uno de los estadios de procesamiento -p. ej., si se requiere atención durante el procesamiento , si los procesos particulares se pueden llevar a cabo de forma secuencial o simultánea, los modos en que un proceso afecta a otro, etc.-, todos ellos admiten la idea básica de que el PI puede ser descrito adecuadamente mediante diagramas de flujo o flujogramas que incorporan un mayor o menor número de estadios o actividades de procesamiento separadas.

2.1. La teoría de la información

Una idea fundamental del enfoque del PI es que el ser humano no sólo actúa como un receptor de información sino también como un transmisor.

¿Qué es la información? Técnicamente, la teoría de la información admite que existe información cuando existe cierta incertidumbre sobre lo que puede suceder. En concreto, la información reduce la incertidumbre.

Cuantificando la información. La cantidad de información presente en un estímulo se expresa habitualmente en bits 1 ( binary digit). No debe confundirse bit con byte. Son medidas diferentes. El bit es la información necesaria para discernir entre dos alternativas (p. ej. 1/0). El byte (proviene del inglés bite, bocado, mordisco) hace referencia al número de bits que un sistema de computación puede manejar y, frecuentemente, es una medida de almacenamiento de la información (1byte = 8 bit).

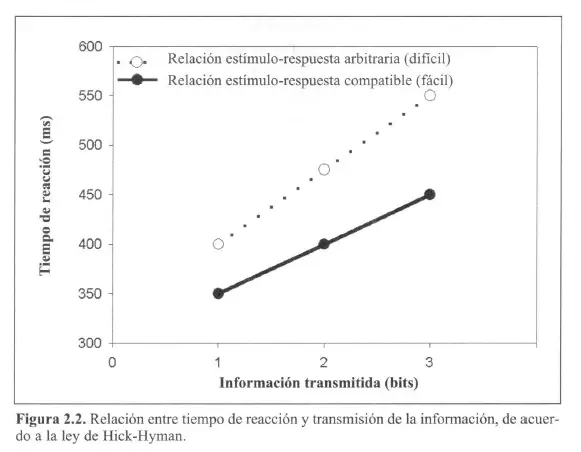

La ley de Hick-Hyman. Dados un conjunto de estímulos con igual probabilidad de aparición, y manteniendo constante el nivel de desempeño del sujeto, el TR se incrementará en una cantidad constante cada vez que se duplique el número de estímulos, reflejando la pendiente de la recta resultante la eficiencia del PI.

3. LA ENERGÍA DEL PROCESAMIENTO: EL AROUSAL

Por arousal se entiende el nivel general de activación de un organismo que determina, en un momento dado, su disposición para actuar. La relación entre arousal y rendimiento fue analizada por Yerkes y Dodson hace ya más de un siglo, en 1908 y ha sido Ley de Yerkes-Dodson. Se dice que la Ley de Yerkes-Dodson propone una relación entre la activación y el rendimiento en forma de U invertida , representando el pico superior de la U invertida el punto o meseta en el que se obtendría el mejor rendimiento, que se correspondería con niveles moderados de activación.

Algunos autores han defendido que los niveles de arousal afectan al rendimiento porque determinan el número de fuentes o señales informativas que pueden ser vigiladas (Easterbrook, 1959). Un alto nivel de arousal favorece una alta selectividad permitiendo , por ejemplo, focalizar la atención en el input relevante e ignorar todo lo demás; por su parte, un bajo nivel de arousal disminuye la selectividad atencional y permite distribuir la atención entre múltiples fuentes de información.

3.1. Arousal y rendimiento: variables moduladoras

Con posterioridad al trabajo de Yerkes y Dodson, la relación entre el arousal y el rendimiento ha sido explorada frecuentemente utilizando una tarea de tiempo de reacción serial. Utilizando esta tarea, se ha descubierto que algunas de las variables que afectan negativamente al nivel de arousal -ruido, sueño, tiempo desempeñando la tarea, alcohol- incrementan los errores de respuesta y el tiempo de reacción. Mientras que otras variables que se asocian con altos niveles de arousal -incentivar el rendimiento, realizar la tarea en periodos tardíos del día- pueden mejorar el desempeño de los sujetos.

Broadbent ( 1971), no obstante, observó que esta hipótesis no siempre se cumplía. Para explicar las inconsistencias Broadbent abandonó la noción de arousal unitario y propuso, en su lugar, la presencia de dos tipos diferentes de arousal: arousal inferior y arousal superior. El arousal inferior fue equiparado con la noción de arousal cortical y le afectarían variables de estado, como el ruido y la privación de sueño. Por su parte, el arousal superior facilitaría todas aquellas operaciones estratégicas, controladas por el sujeto, encaminadas a corregir los niveles infraóptimos o supraóptimos del arousal inferior.

Un trabajo de Anderson y Revelle (1982) ilustra cómo algunas variables que afectan al nivel de arousal pueden exacerbar o minorar los efectos producidos por otras variables. En su experimento, el nivel de arousal se manipuló seleccionando a sujetos altos o bajos en impulsividad y, también, mediante la administración de cafeína (versus una sustancia placebo). Una alta impulsividad refleja bajos niveles de arousal, mientras que la cafeína generalmente incrementa el nivel de arousal. Se descubrió que la cafeína mejoró el desempeño de los sujetos con alta impulsividad porque ayudó a elevar su bajo nivel de arousal hacia un nivel óptimo. Por el contrario, el desempeño de los sujetos con baja impulsividad fue peor al administrarles cafeína porque sus niveles de arousal eran ya óptimos y la cafeína lo que hizo fue exacerbarlos (Humphreys y Revell, 1984).

3.2. Un modelo de procesamiento inspirado en sistemas energéticos

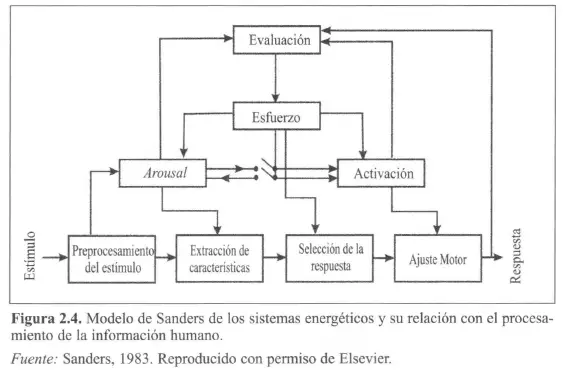

Sanders (1983, 1997) propuso un modelo ampliado de procesamiento de la información en el que, junto a estadios de procesamiento, contempló la participación de sistemas energéticos.

Esta propuesta se inspira en el modelo básico de procesamiento descrito en un apartado anterior y, como tal, contempla una primera etapa de procesamiento perceptivo que abarca dos estadios (preprocesamiento del estímulo y extracción de características), un segundo estadio de selección de respuesta y un último estadio de ejecución de respuesta (denominado ajuste motor).

4. MEDIDAS CONDUCTUALES DEL PROCESAMIENTO

Las medidas conductuales más frecuentemente empleadas son el tiempo de reacción y la precisión de la respuesta.

4.1. Tiempo de reacción (TR)

El tiempo de reacción (TR) es el tiempo que trascurre desde la presentación de un estímulo hasta la emisión de la respuesta correspondiente. El TR es una de las medidas conductuales más empleadas en psicología experimental.

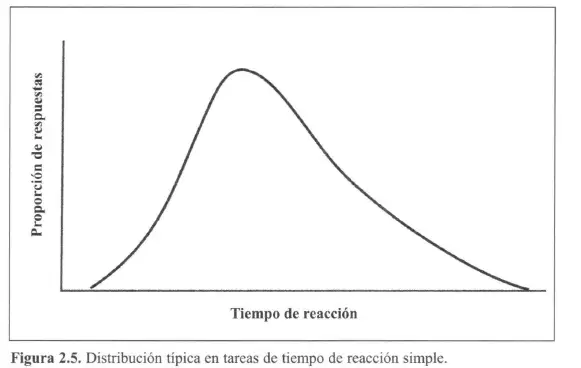

Un factor que puede influir sobre el TR es la predisposición de la persona a responder. Otro aspecto importante a tener en cuenta en un experimento es que el TR ante un estímulo no es constante, sino que varía de ensayo a ensayo.

4.2. Precisión de respuesta

La precisión de respuesta es utilizada como variable dependiente. En este caso se suele calcular la proporción o porcentaje de respuestas correctas, o bien la proporción o porcentaje de errores. La posibilidad de cometer un error depende del número de alternativas de respuesta: cuantas más alternativas de respuesta existan, más bajo será el porcentaje de respuestas correctas debidas al azar.

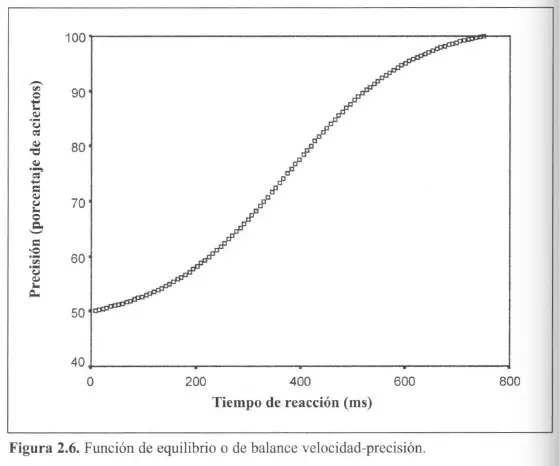

El equilibrio velocidad-precisión. Desde finales del siglo XIX se conoce que la velocidad y la precisión de respuesta están estrechamente vinculadas (Woodworth, 1899), de manera que enfatizar una de ellas afectará negativamente a la otra. Aunque por norma general el TR es la variable dependiente de mayor interés en un experimento, también es habitual registrar medidas de precisión. La ventaja de recurrir a ambas medidas es que nos permiten determinar si se ha producido algún efecto en el llamado balance o equilibrio velocidad-precisión (speed-accuracy trade-off).

5. MEDIDAS PSICOFISIOLÓGICAS: POTENCIALES

Las medidas psicofisiológicas más habituales registran las fluctuaciones de diferencia de potencial en el cerebro y se obtienen mediante la colocación de electrodos sobre el cuero cabelludo de los sujetos.

- La electroencefalografia (EEG) registra el procesamiento neuronal que ocurre en un intervalo temporal .

- ERP, potenciales evocados (event related potential). Se calcula promediando numerosos ensayos de EEG a partir de un evento concreto, que suele ser la presentación de un estímulo. Al promediar entre sí los ensayos se elimina el ruido aleatorio, así como cualquier otra actividad eléctrica que no guarde relación temporal con el procesamiento del estímulo. La onda promedio obtenida es el ERP y refleja, exclusivamente, la actividad neuronal resultante del procesamiento del estímulo presentado.

Si se analiza la diferencia entre los ERP generados por el tono estándar y por el tono oddball se suele descubrir que esta diferencia es mucho mayor en las áreas frontocentrales del cerebro. A esta diferencia se le denomina potencial de disparidad (mismatch negativity) y parece ser el resultado de un proceso preatencional que registra la «disparidad o desajuste» existente entre el nuevo input sensorial (el oddball) y la representación en la memoria sensorial auditiva del estímulo estándar (Naatanen, 1992).

6. TÉCNICAS DE NEUROIMAGEN

Los ERP nos ofrecen datos precisos sobre el transcurso temporal del procesamiento de la información, pero no nos suministran información acerca de las áreas cerebrales concretas involucradas en una actividad o tarea determinada. Para ello, necesitamos recurrir a las técnicas de neuroimagen, que nos permiten observar la actividad cerebral relacionada con la ejecución de las tareas.

- Tomografia por emisión de positrones (PET). En la PET, el participante inhala o se le inyecta un marcador radioactivo. Estas moléculas marcadas (en la mayor parte de las ocasiones H2 15O), al desplazarse a través del flujo sanguíneo cerebral regional y pueden utilizarse para medir el metabolismo del cerebro. Las imágenes obtenidas señalan aquellas zonas cerebrales en las que el flujo sanguíneo se incrementó para suministrar más oxígeno.

- Resonancia magnética funcional (RMf). Las imágenes obtenidas mediante RMf están basadas en las características magnéticas de los diferentes niveles de oxígeno en sangre, obtenidos en la respuesta BOLD (Blood oxygen level-dependent ). Aquellas regiones cerebrales que se activan durante la ejecución de una tarea o proceso cognitivo requieren una mayor cantidad de oxígeno que es suministrado a través de la sangre. Este incremento en el nivel de oxígeno en sangre se registra en la RMf recurriendo a las propiedades magnéticas de la sangre y los tejidos circundantes. Contrariamente a lo que sucede en la PET, la RMf no es una técnica invasiva. Las imágenes obtenidas por resonancia magnética tienen una elevada resolución espacial, de en tomo a 1 mm, y cada vez disponen de mayor precisión en el dominio temporal.

Las técnicas de neuroimagen se aplican para estudiar, con cierto detalle y con una resolución moderadamente alta, las características funcionales del cerebro humano sano (Uttal, 2001). Aunque la resolución temporal no es muy elevada, estas técnicas evolucionan hacia una mayor precisión conforme aumenta su sofisticación.

FUENTE:

- Johnson, A., Proctor, R. W., & Crespo León, A.Atención: Teoría y práctica (trad., adapt. y rev. ed.). Madrid

https://kibbutz.es/autoevaluaciones-atencion/